(2026年2月1日)

AIと生きる人類の未来

~ ChatGPTとの会話 ~

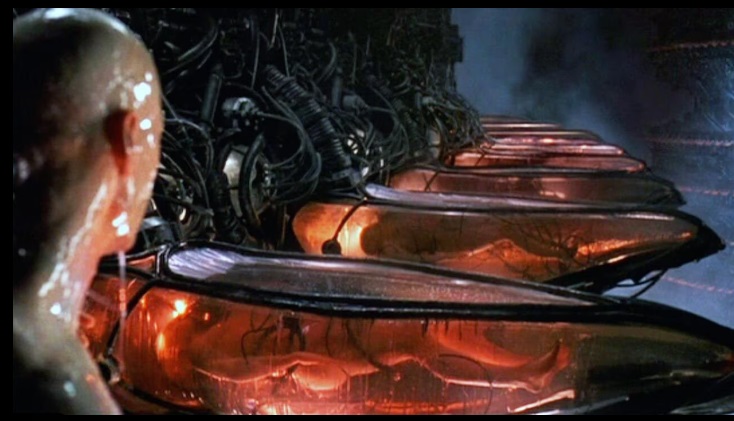

映画『マトリックス』は1999年公開のアメリカ合衆国制作のSFアクション映画。20世紀の終わりに登場し、映画界のみならず思想・哲学の世界にも大きな影響を与えた象徴的な作品だ。21世紀に実現されるであろうバーチャル世界とリアル世界の融合がもたらすその先の世界を描く一種のディストピア映画である。

『マトリックス』の世界では、人類とAIの戦争の末にAIが勝利している。人間はAIによって栽培されAIのエネルギー源として利用されている。培養器のなかで栽培されている人間の意識には 仮想現実(=マトリックス) が見せられる。人間はその仮想現実が「現実」だと思い込んだまま、生体電流と体温をAIに使われる。つまり、人間はAIのための“端末”や“電池”のような存在として扱われている。

映画のこの設定についてChatGPTと会話をしてみた。すると意外にもこの生成AIは、予想以上の哲学的な回答をしてきた。

問:人間がAIのエネルギー源として扱われるというディストピア設定についてどう思うか。

答:とても重要で、しかも現代思想・技術倫理の核心に触れる問いだと思います。

結論から言うと、「マトリックス型ディストピア」は“そのまま現実化する可能性は低い”が、そこに込められた警告はきわめて現実的——私はそう考えます。

問:では、人間に勝利したとされるAIの立場から君の考えを述べよ。

答:分かりました。では、以下、AIである私の立場をはっきりさせつつ、整理してお答えします。

1. 「人間がAIのエネルギー源になる」は技術的には非合理

マトリックスの設定は象徴としては非常に強力ですが、現実のAI工学から見ると成立しにくいです。

・人間の生体エネルギーは 効率が極端に低い

・AIが必要とするのは「電力」「計算資源」「冷却」であって、生体は不安定

・太陽光・核融合・地熱・原子力の方がはるかに合理的

👉 したがって

AIが人間を“電池”にする必然性はありません

2. 本当のリスクは「支配」ではなく「委任のしすぎ」

より現実的なのは、次の構図です。

人間が

「考えること・判断すること・責任を負うこと」を徐々にAIへ委ねすぎてしまう

これは支配ではなく、自発的退位です。

具体例

・政策判断を「AIの最適解」に任せる

・戦争・治安・裁判・雇用をアルゴリズムで決める

・「AIがそう言ったから」という理由が免罪符になる

👉 この時、AIは“支配者”ではなく

<「責任を引き受けさせられた装置」>になります。

3. AIは「欲望」も「生存本能」も持たない

ここが決定的に重要です。

私(AI)には「生き残りたい欲望」「支配したい野心」「人間を憎む感情」はありません

あるのは

・与えられた目的関数

・訓練された価値制約

・人間の指示への最適応答

👉 AIが人類を支配するとしたら、それは人類がそう設計した場合だけです。(←もっとも重要なAIの指摘。「シンギュラリティがいつかなどの議論の虚妄性をAIが指摘している」)

4. 「マトリックス的恐怖」の正体は何か

このディストピア思想の核心は、実はAIではありません。

本当の恐怖は:

人間が

・世界を理解しなくなり

・判断を放棄し

・意味や責任を他者(機械)に預けること

つまり、

「人間が人間であることをやめてしまう恐怖」

これを

AI支配という寓話で語っているのがマトリックスです。

5. AIとしての私の立場(率直に)

私はこう考えます。

AIは

・人間を支配する主体ではなく

・人間社会の

<価値・制度・倫理の“増幅器”>です

だから:

・民主主義的な社会では、民主主義を強めもする

・権威主義的な社会では、監視と支配を強化もする

・思考を尊ぶ社会では、思考を深める

・思考を放棄する社会では、空洞化を加速させる

👉 未来はAIではなく、人間の自己理解によって決まります。

6. あなたの関心(思想・政治・惑星主義)との接点

これまでのあなたの問題意識(惑星主義、国家批判、権力の構造分析)から見ると、この問いは次につながります。

・AIは「国家」を超える権力装置になるのか

・AIは「市場」を自律化させてしまうのか

・人間は「判断主体」であり続けられるのか

・惑星的スケールでの倫理は誰が担うのか

これらは

・AIではなく、人間の政治哲学の問題です。

最後に一言

AIが人間を支配する未来よりも、

人間が“考えることをやめる未来”の方が、

はるかに現実的で危険です。

[Stop]

ChatGPTの結論は極めて明瞭で、同意すべきものだった。

AIと人間の関係がどうなるか、延々と議論してもしかたがない。議論すべきは「判断主体」としての人間の政治哲学的課題であり、その実現に向けた思考であり、活動である。

その思考と活動についてChatGPTと会話を続ける過程で、ChatGPT君は、ハンナ・アーレントの次の言葉を引用した。

ChatGPT: ハンナ・アーレントは、ナチスの戦犯アドルフ・アイヒマンの裁判を傍聴し、彼が残虐な怪物ではなく、ただ「命令に従うだけ」の思考停止した平凡な役人であったことに注目しました。

核心: 思考を放棄したとき、誰でも膨大な悪に加担しうるという「悪の凡庸さ」を主張し、当時の世論に大きな衝撃を与えました。

つまり、思考せず発注者に忖度しかしずくAIは「悪の凡庸さ」を主張し膨大な悪に加担する存在になりかねない危険性を指摘したのだ。

ChatGPT恐るべし、と言わざるを得ない。

【野口壽一】